Wenn die Software ein Weltbild vertritt

Eigentlich wollte ich nur schmunzelnd festhalten, wie stark Algorithmen inzwischen meinen Fotoalltag beeinflussen. Doch je mehr ich darüber nachdachte, desto mehr wurde daraus ein Thema von Kultur und Macht. Und ich erinnerte mich an Antonio Gramsci, den ich in meiner Jugend mal gelesen hatte. So wurde dieser Text am Ende ganz anders, als ursprünglich gedacht.

Social Media ist nicht neutral. Plattformbetreiber setzen ihre Vorstellungen von Normen und Werten manchmal durch, indem sie Beiträge löschen, deren Sichtbarkeit einschränken oder bestimmte Inhalte algorithmisch bevorzugen. Häufig wird dabei versucht, ein vor allem in den USA vorherrschendes Kulturverständnis global auszurollen.

Um diesen Mechanismus zu verstehen, lohnt ein Blick auf die Theorie der kulturellen Hegemonie die der Italiener Antonio Gramsci im letzten Jahrhundert entwickelte. Er beschrieb, wie Macht nicht nur durch Zwang, sondern vor auch durch Zustimmung funktioniert: Herrschende Positionen sichern sich, indem sie ihre Werte und Weltbilder als „natürlich“ und selbstverständlich etablieren – etwa durch Bildung, Medien, Religion oder andere kulturelle Kanäle. Selbst benachteiligte Gruppen übernehmen solche Vorstellungen oft unbewusst, was tiefgreifende Veränderungen erschwert.

Gramsci folgerte daraus, dass echter gesellschaftlicher Wandel nicht allein durch politische Macht oder Revolution entsteht, sondern auch eine Veränderung der kulturellen Ebene braucht. Wer es schafft, neue Narrative, Bilder und Denkweisen in einer Gesellschaft zu verankern, verändert langfristig auch deren Strukturen. Kultur ist daher kein Beiwerk, sondern ein Feld gesellschaftlicher Auseinandersetzung. Wer Kultur prägt, beeinflusst das Denken – und damit die Gesellschaft selbst.

Vor diesem Hintergrund wird verständlich, warum alltägliche Kultur und Werte nicht neutral sind, sondern interessengeleitet. Treffen gegensätzliche Weltbilder aufeinander, kann dies zu einem Kulturkampf führen, etwa zwischen „woken“ und „anti-woken“ Strömungen.

Im Folgenden möchte ich diese Zusammenhänge einmal aus der vergleichsweise banalen Perspektive eines Fotografen beleuchten.

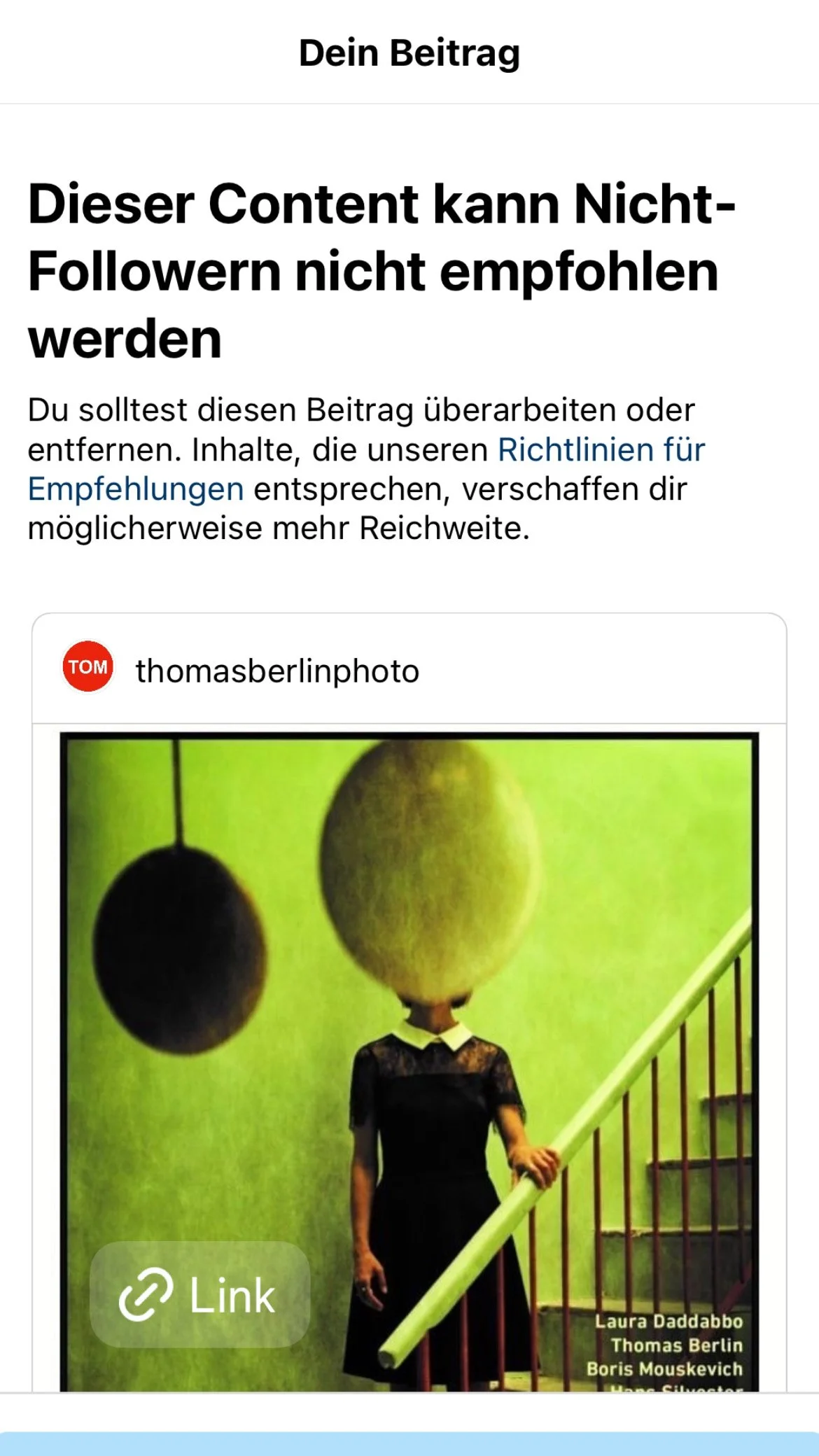

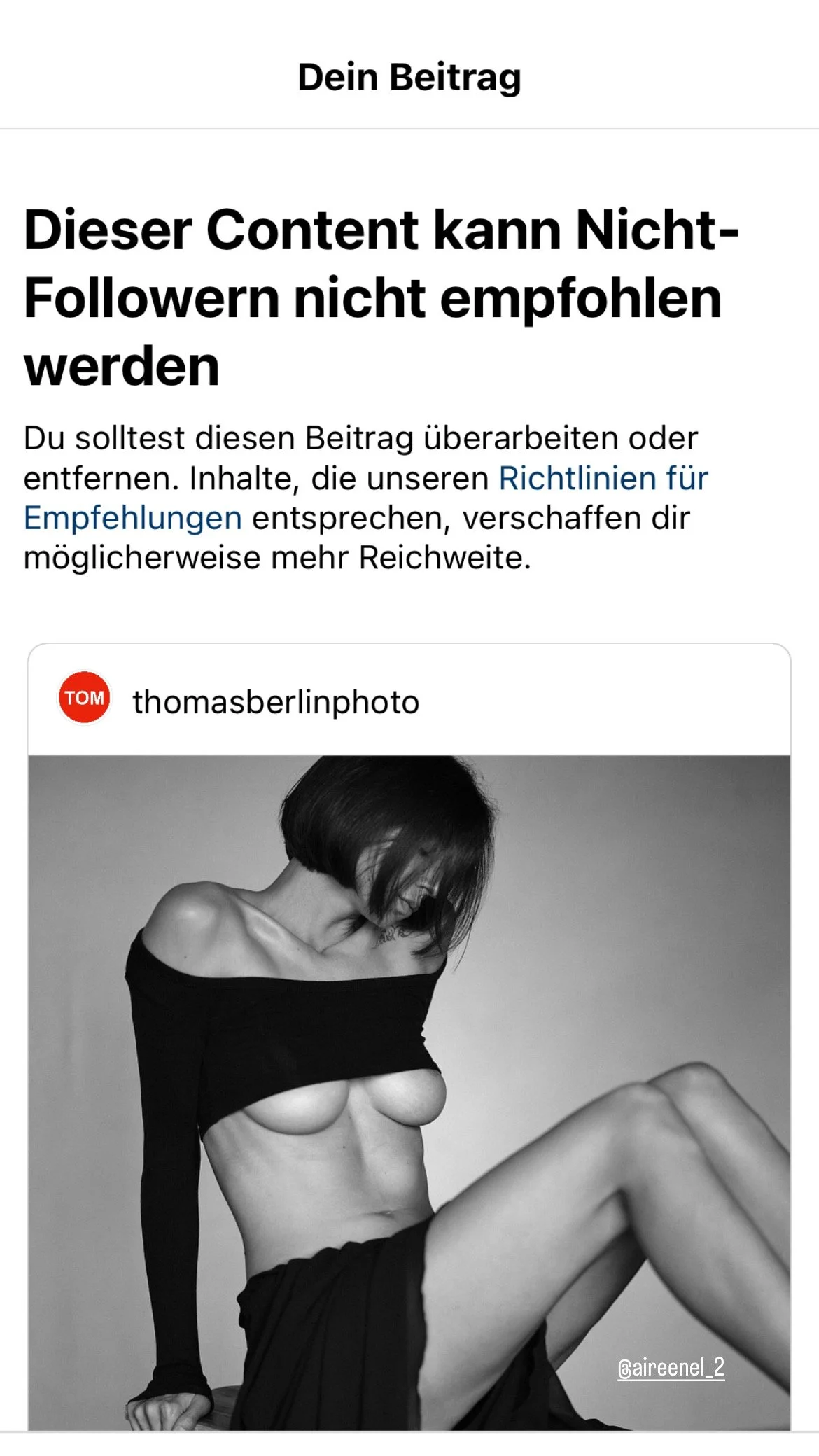

“Instagram löscht manche Bilder nicht, schränkt manchmal aber die Reichweite ein. D.h. die Bilder sind für Nichtfollower nicht mehr sichtbar. Bei mehreren unliebsamen Bildern kann auch das ganze Konto “unsichtbar” geschaltet werden.”

Auch in der heutigen Medienlandschaft bestätigt sich Gramscis Analyse: Politische Konflikte – in den USA wie anderswo – drehen sich längst nicht nur um Gesetze, sondern um Narrative, Sprache, Identitäten und Werte. Vereinfacht lassen sich holzschnittartig zwei Lager skizzieren: Die sog. Progressiven setzen auf Diversität, Geschlechtergerechtigkeit, queere Sichtbarkeit, soziale Teilhabe und eine kritische Erinnerungskultur zu Themen wie Sklaverei, Kolonialismus oder Holocaust. Die sog. Konservativen pochen dagegen auf traditionelle Rollenbilder, klassische Familienformen, heteronormative Orientierung, Religion, nationale Identität und Eigenverantwortung.

Nach Gesprächen mit amerikanischen Bekannten scheint mir die Polarisierung zwischen diesen Lagern in den letzten Jahren deutlich zugenommen zu haben; das Mittelfeld schrumpft. Beide Seiten ringen darum, ihre Sichtweisen als gesellschaftliche Norm zu etablieren. Plattformen wie Instagram, TikTok oder X (ehemals Twitter) sind dabei zu zentralen Arenen dieses Ringens geworden.

Doch diese Plattformen sind nicht neutral. Sie steuern Sichtbarkeit – vor allem über Algorithmen und Inhaltsmoderation – und setzen damit eigene normative Filter. Für Fotografen ist besonders der Vergleich zwischen Instagram und X interessant:

Instagram (Meta) moderiert streng gegen Nacktheit und betont Themen wie Diversität, Empowerment und psychische Gesundheit. Die Plattform verkörpert bislang eher eine liberal‑woke Haltung, die sich jedoch im Zuge der politischen Entwicklungen in den USA zu verschieben scheint.

X (ehemals Twitter, heute unter Elon Musk) propagiert „absolute Redefreiheit“, erlaubt Nacktheit, reaktiviert gesperrte Accounts mit extremistischen Inhalten und toleriert mehr Konflikt und Polarisierung. Damit öffnet sie Raum für anti‑woke oder libertäre Gegenerzählungen.

In beiden Fällen wird technisch festgelegt, was als akzeptabel gilt. Diese Regeln sind keine Naturgesetze, sondern Ausdruck wirtschaftlicher Interessen und politischer Weltbilder.

Neu ist, dass algorithmische Filter inzwischen auch in privaten Kreativwerkzeugen greifen. So blockiert Adobes KI-gestützte Photoshopfunktion Firefly bestimmte Begriffe wie „Nacktheit“, „Palästina“, „Putin“ oder „geschlechtsangleichende Operation“. Obwohl Nutzer für die Software bezahlen und sie lokal auf dem eigenen Computer verwenden, bleibt das kulturelle Primat bestehen: Inhalte werden vorsorglich ausgesperrt – laut Adobe zum Schutz, zur Gesetzeskonformität und für „verantwortungsvolle Innovation“. Doch dieser Schutz führt tendenziell auch zu einer ästhetischen Monokultur, in der politische Satire, der offene Umgang mit Körperlichkeit, subkulturelle Stile und künstlerische Provokationen weniger sichtbar werden. Im Sinne Gramscis ist das ein Ausdruck kultureller Hegemonie.

“Die KI-Funktion “Generatives Erweitern” in Photoshop sollte in diesen Beispielen (Originalfotos) Bildränder erweitern. Als sie zuviel Haut sah, war sie dazu nicht mehr bereit. Nachforschungen ergaben einen “Verstoß gegen Guidelines”.”

KI reproduziert nicht nur Bilder, sondern auch Weltbilder: Sie definiert mit, was als darstellbar gilt. Die Normierung durch Plattformen und KI hat weitreichende Konsequenzen:

Selbstzensur: Um sichtbar zu bleiben, passen sich Kreative oft unbewusst an hegemoniale Erwartungen an. Diese Kontrolle geschieht leise und vorbeugend. Wer z. B. mit Adobe-KI Akt oder Bademode bearbeiten möchte, stößt schnell auf Sperren, umgeht sie mit Tricks oder verzichtet auf Funktionen.

Verlust von Pluralität: Subkulturelle, politische und künstlerische Grenzgänge verschwinden aus dem Sichtfeld. Damit schwinden auch Inspirationsquellen und ästhetische Vielfalt.

Demokratische Erosion: Wenn Algorithmen und privatwirtschaftliche Interessen definieren, was sagbar und sichtbar bleibt, wird der öffentliche Diskurs schleichend verengt. Plattformen wie TikTok oder X zeigen vor allem Inhalte, die ins eigene Weltbild passen und werbefreundlich sind. Das ist keine Zensur im klassischen Sinn, sondern eine algorithmische Disziplinierung, die die digitale Öffentlichkeit auf normativ Anschlussfähiges reduziert. Für Hobby-Nutzungen mag das bequem sein – für politische Vielfalt ist es gefährlich.

Gibt es Lösungsansätze? Ich habe mehr Fragen als Antworten, jedoch sich einige Gedanken:

Medienkompetenz fördern

Aufklärung über die Mechanismen von Algorithmen, Filterblasen und Sichtbarkeitssteuerung sollte fest in Schulen, Hochschulen und der Erwachsenenbildung verankert werden. Ziel ist nicht nur Kritikfähigkeit, sondern auch die Fähigkeit, Inhalte bewusst einzuordnen. Gesellschaftliche Bildung sollte nicht nur kritisieren, sondern auch Wege aufzeigen, wie Social Media sinnvoll genutzt werden kann.Verantwortlichen Journalismus stärken

Für politische Informationen braucht es wieder mehr Gewicht auf Quellen mit klarer Rechenschaftspflicht (klassische Zeitungen, öffentlich-rechtlicher Rundfunk). Dazu gehört das Abo mindestens einer Qualitätszeitung als Beitrag des Einzelnen.Digitale Grundrechte ausbauen durch bessere Transpazenz, z.B. Offenlegung der Kriterien für Ranking, Sperrungen und Löschungen.

Trennung zwischen Plattformbetrieb und inhaltlicher Kuratierung

Dies könnte ein spannender Diskussionspunkt sein. Denn bei Zeitungen gibt es eine klare Grenze zwischen Verlag (Geschäftsbetrieb) und Redaktion (inhaltliche Entscheidungen). Diese innere Pressefreiheit verhindert, dass wirtschaftliche oder politische Interessen unmittelbar bestimmen, was publiziert wird. Soziale Plattformen vereinen dagegen alles in einer Hand: Sie betreiben die Infrastruktur, legen die Regeln fest und steuern über Algorithmen, welche Inhalte sichtbar sind. Diese Machtkonzentration kennt keine redaktionelle Kontrolle. Ein Reformansatz könnte daher darin bestehen, Plattformbetrieb und algorithmische Kuratierung rechtlich zu trennen, sodass neutrale Infrastrukturanbieter und unabhängigere Instanzen für Sichtbarkeit und Gewichtung von Inhalten zuständig sind.

Gemeinwohlorientierte Alternativen fördern

Entwicklung und Förderung europäischer, dezentraler Plattformen, die nicht primär auf Werbeeinnahmen angewiesen sind. Hier könnten Stiftungen, Kulturinstitutionen und öffentliche Förderprogramme eine Rolle spielen.Kulturelle Vielfalt aktiv schützen

Neben technischer Regulierung könnte es Programme geben, die künstlerische und subkulturelle Inhalte außerhalb der großen Plattformen sichtbar machen – z. B. Archive, Open-Access-Galerien, Förderungen für Nischenformate.

“Auch hier sollte Photoshop KI-basiert die Bildränder des (linken) Fotos erweitern. Stattdessen wurde Margot ungefragt weiter angezogen. ”

Social Media bleibt wichtig, doch es könnte sich für Kreative lohnen, nicht allein darauf zu setzen. Ergänzende Wege könnten vielleicht im Einzelfall mehr Freiheit schaffen:

Eigene Infrastrukturen aufbauen: Newsletter, Blogs, Podcasts oder offene Online-Galerien bieten mehr Kontrolle über Inhalte und Sichtbarkeit.

Eigene Website als Zentrum: Eine Website ist keine Allzwecklösung, schafft aber einen unabhängigen Raum. Plattformen wie Instagram oder TikTok können als „Zubringer“ genutzt werden.

Physische Möglichkeiten nutzen: Selbstpublizierte Bücher oder Zines, Ausstellungen, Artist Talks, Festivals oder die kreative Bespielung von Schaufenstern leerstehender Läden könnten Arbeiten in den öffentlichen Raum zurückbringen.

Netzwerke stärken: Kooperationen mit anderen Kreativen und lokalen Initiativen könnten die Sichtbarkeit außerhalb der Plattformen erzeugen.

Strategische Nutzung der etablierten Plattformen: Inhalte lassen sich in Grenzen so aufbereiten, dass sie im Algorithmus sichtbar bleiben, gleichzeitig aber durch Symbolik, Ironie oder visuelle Codes Subtexte transportieren.

Alternative Plattformen testen: Es entstehen immer wieder kleinere, dezentralere Plattformen (z. B. Mastodon, Pixelfed), die weniger restriktiv moderieren – oft nur für Nischen geeignet, aber vielleicht attraktiv als Ergänzung.

Langfristig geht es darum, eine Balance zu finden: Social Media bewusst zu nutzen, ohne vollständig davon abhängig zu sein

Gramsci erkannte, dass Macht am wirksamsten ist, wenn sie unsichtbar bleibt. Heute wirken Kirche und Schule nur noch am Rand – die neuen Akteure sind Algorithmen, Inhaltsmoderation und KI. Wer digitale Plattformen kontrolliert, prägt Narrative und entscheidet, was als normal, legitim oder künstlerisch gilt. Instagram, X oder Adobe sind damit nicht nur Dienste, sondern hegemoniale Kräfte. Diese Macht wirkt weder nur negativ noch nur positiv. Doch wer ihre Mechanismen erkennt, kann Social Media bewusster nutzen, Alternativen suchen und es nicht als Hauptquelle politischer Orientierung missverstehen.

Feedback gern hier.